Το Εθνικό Κέντρο Ασφάλειας Κυβερνοασφάλειας (NCSC) του Ηνωμένου Βασιλείου προειδοποιεί ότι τα εργαλεία

τεχν

ητής νοημοσύνης (AI) θα έχουν αρνητικό βραχυπρόθεσμο αντίκτυπο στην ασφάλεια στον κυβερνοχώρο, συμβάλλοντας στην κλιμάκωση της απειλής του ransomware.

Η υπηρεσία αναφέρει ότι οι κυβερνοεγκληματίες χρησιμοποιούν ήδη την τεχνητή νοημοσύνη για διάφορους σκοπούς και το φαινόμενο αναμένεται να επιδεινωθεί τα επόμενα δύο χρόνια, συμβάλλοντας στην αύξηση του όγκου και της σοβαρότητας των κυβερνοεπιθέσεων.

Το NCSC

πιστεύει

ότι η τεχνητή νοημοσύνη θα επιτρέψει σε άπειρους παράγοντες απειλών, χάκερ προς ενοικίαση και χακτιβιστές χαμηλής ειδίκευσης να διεξάγουν πιο αποτελεσματικές, προσαρμοσμένες επιθέσεις που διαφορετικά θα απαιτούσαν σημαντικό χρόνο, τεχνικές γνώσεις και επιχειρησιακή προσπάθεια.

Οι περισσότερες διαθέσιμες

πλατφόρμες

μεγάλων μοντέλων εκμάθησης (LLM), όπως το ChatGPT και το Bing Chat, διαθέτουν διασφαλίσεις που εμποδίζουν την πλατφόρμα να δημιουργήσει κακόβουλο περιεχόμενο.

Ωστόσο, το NCSC προειδοποιεί ότι οι εγκληματίες στον κυβερνοχώρο κατασκευάζουν και εμπορεύονται εξειδικευμένες παραγωγικές

υπηρεσίες

τεχνητής νοημοσύνης που έχουν σχεδιαστεί ειδικά για την ενίσχυση εγκληματικών δραστηριοτήτων. Παραδείγματα περιλαμβάνουν το WormGPT, μια υπηρεσία LLM επί πληρωμή που επιτρέπει στους παράγοντες απειλών να δημιουργούν κακόβουλο περιεχόμενο, συμπεριλαμβανομένων κακόβουλου λογισμικού και θέλγητρα ηλεκτρονικού ψαρέματος.

Αυτό δείχνει ότι η

τεχνολογία

έχει ήδη ξεφύγει από τα όρια των ελεγχόμενων, ασφαλών πλαισίων, καθιστώντας προσβάσιμη στο ευρύτερο εγκληματικό οικοσύστημα.

«Οι φορείς απειλών, συμπεριλαμβανομένων των παραγόντων ransomware, χρησιμοποιούν ήδη την τεχνητή νοημοσύνη για να αυξήσουν την αποδοτικότητα και την αποτελεσματικότητα πτυχών των κυβερνοεπιχειρήσεων, όπως η αναγνώριση, το ηλεκτρονικό ψάρεμα και η κωδικοποίηση», προειδοποιεί το NCSC σε ξεχωριστή ανακοίνωση.

εκτίμηση απειλών

.

«Αυτή η τάση θα συνεχιστεί σχεδόν σίγουρα μέχρι το 2025 και μετά».

Η έκθεση σημειώνει ότι ο ρόλος της τεχνητής νοημοσύνης στο τοπίο των κινδύνων στον κυβερνοχώρο αναμένεται να είναι εξελικτικός, ενισχύοντας τις υπάρχουσες απειλές και όχι μετασχηματιστικό.

Τα βασικά σημεία της αξιολόγησης του NCSC είναι τα ακόλουθα:

- Η τεχνητή νοημοσύνη πιθανότατα θα εντείνει τις επιθέσεις στον κυβερνοχώρο τα επόμενα δύο χρόνια, ιδιαίτερα μέσω της εξέλιξης των τρεχουσών τακτικών.

- Τόσο οι ειδικευμένοι όσο και οι λιγότερο ειδικευμένοι φορείς απειλών στον κυβερνοχώρο, συμπεριλαμβανομένων κρατικών και μη κρατικών φορέων, χρησιμοποιούν επί του παρόντος τεχνητή νοημοσύνη.

- Η τεχνητή νοημοσύνη ενισχύει την αναγνώριση και την κοινωνική μηχανική, καθιστώντας τα πιο αποτελεσματικά και δύσκολο να εντοπιστούν.

-

Η εξελιγμένη χρήση της τεχνητής νοημοσύνης σε

επιχειρήσεις

στον κυβερνοχώρο θα περιοριστεί κυρίως σε φορείς με πρόσβαση σε ποιοτικά δεδομένα, τεχνογνωσία και πόρους μέχρι το 2025. - Η τεχνητή νοημοσύνη θα καταστήσει τις επιθέσεις στον κυβερνοχώρο κατά του Ηνωμένου Βασιλείου πιο αποτελεσματικές, επιτρέποντας ταχύτερη, πιο αποτελεσματική ανάλυση δεδομένων και εκπαίδευση μοντέλων τεχνητής νοημοσύνης.

- Η τεχνητή νοημοσύνη μειώνει τα εμπόδια εισόδου για αρχάριους εγκληματίες στον κυβερνοχώρο, συμβάλλοντας στην παγκόσμια απειλή ransomware.

- Μέχρι το 2025, η εμπορευματοποίηση των δυνατοτήτων τεχνητής νοημοσύνης πιθανότατα θα επεκτείνει την πρόσβαση σε προηγμένα εργαλεία τόσο για εγκληματίες του κυβερνοχώρου όσο και για κρατικούς παράγοντες.

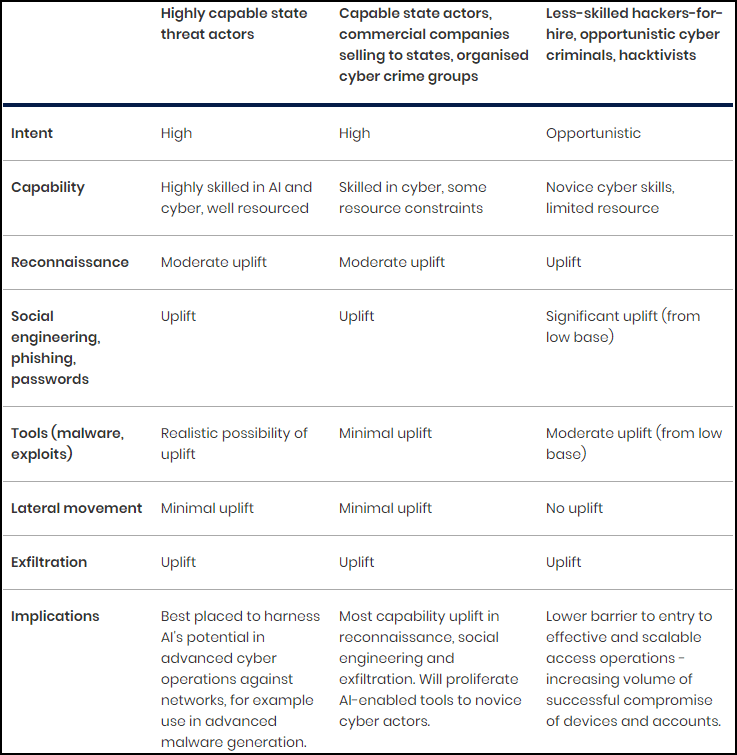

Ο παρακάτω πίνακας συνοψίζει τις επιπτώσεις που αναμένεται να έχει η τεχνητή νοημοσύνη σε συγκεκριμένες περιοχές απειλής για τρία επίπεδα δεξιοτήτων.

Για τα εξελιγμένα APT, το NCSC πιστεύει ότι η τεχνητή νοημοσύνη θα τους βοηθήσει να δημιουργήσουν προσαρμοσμένο κακόβουλο λογισμικό αποφυγής πιο εύκολα και πιο γρήγορα.

“Το AI έχει τη δυνατότητα να δημιουργήσει κακόβουλο λογισμικό που θα μπορούσε να αποφύγει τον εντοπισμό από τα τρέχοντα φίλτρα ασφαλείας, αλλά μόνο εάν είναι εκπαιδευμένο σε ποιοτικά δεδομένα εκμετάλλευσης”, εξηγεί το NCSC

«Υπάρχει μια ρεαλιστική πιθανότητα οι πολιτείες με υψηλή ικανότητα να διαθέτουν αποθετήρια κακόβουλου λογισμικού που είναι αρκετά μεγάλα ώστε να εκπαιδεύουν αποτελεσματικά ένα μοντέλο τεχνητής νοημοσύνης για αυτόν τον σκοπό».

Οι χάκερ μεσαίου επιπέδου θα αποκτήσουν κατά κύριο λόγο πλεονεκτήματα στην αναγνώριση, την κοινωνική μηχανική και την εξαγωγή δεδομένων, ενώ οι λιγότερο εξειδικευμένοι παράγοντες απειλών θα δουν βελτιώσεις σε όλα τα επίπεδα, εκτός από την πλευρική κίνηση, η οποία παραμένει προκλητική.

«Το AI είναι πιθανό να βοηθήσει με κακόβουλο λογισμικό και να εκμεταλλευτεί την ανάπτυξη, την έρευνα ευπάθειας και την πλευρική κίνηση, κάνοντας τις υπάρχουσες τεχνικές πιο αποτελεσματικές», αναφέρει η ανάλυση.

«Ωστόσο, βραχυπρόθεσμα, αυτοί οι τομείς θα συνεχίσουν να βασίζονται στην ανθρώπινη τεχνογνωσία, πράγμα που σημαίνει ότι οποιαδήποτε περιορισμένη ανάταση θα περιοριστεί πολύ πιθανόν σε υπάρχοντες παράγοντες απειλής που είναι ήδη ικανοί».

Συνολικά, το NCSC προειδοποιεί ότι η δημιουργία τεχνητής νοημοσύνης και τα μοντέλα μεγάλων γλωσσών θα καταστήσουν εξαιρετικά δύσκολο για όλους, ανεξαρτήτως εμπειρίας και επιπέδου δεξιοτήτων, τον εντοπισμό απόπειρες phishing, πλαστογράφησης και κοινωνικής μηχανικής.

VIA:

bleepingcomputer.com