Πώς το ChatGPT και το Generative AI θα μπορούσαν να ενισχύσουν την άρνηση της επιστήμης

:

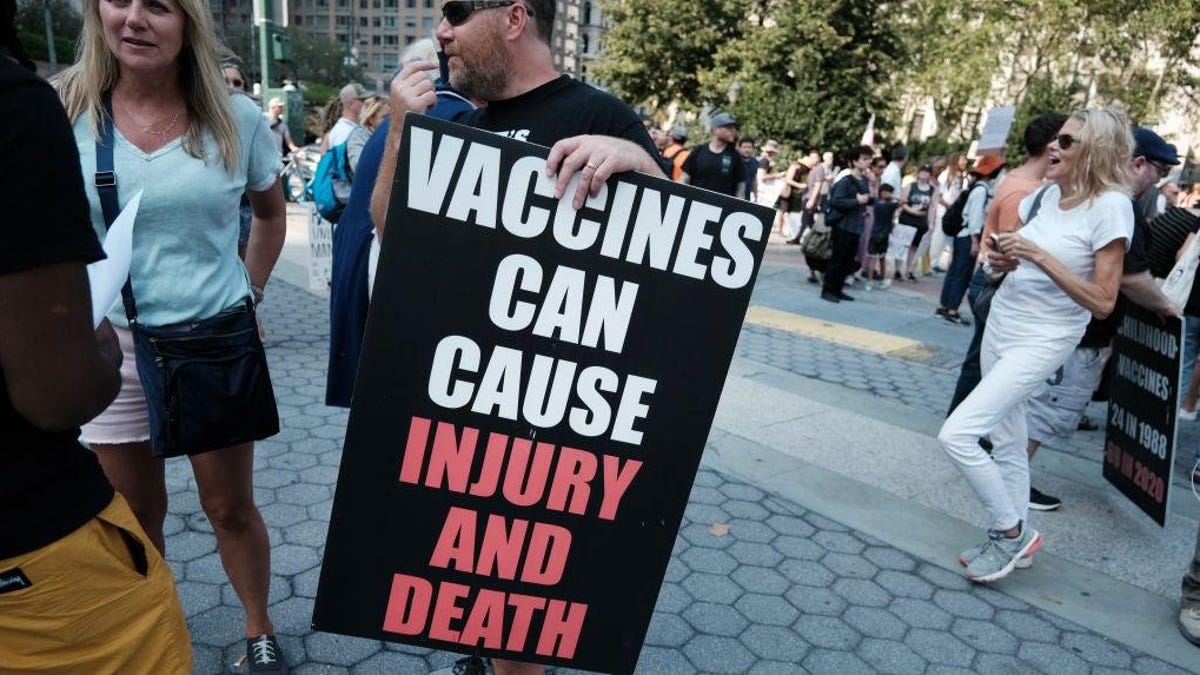

Σπένσερ Πλατ

(

Getty Images

)

Μέχρι πολύ πρόσφατα, αν θέλατε να μάθετε περισσότερα για ένα αμφιλεγόμενο επιστημονικό θέμα – την έρευνα των βλαστοκυττάρων, την ασφάλεια της πυρηνικής ενέργειας, την κλιματική αλλαγή – πιθανότατα κάνατε μια αναζήτηση στο

Google

. Παρουσιάζεται με πολλές πηγές, επιλέγατε τι θα διαβάσετε, επιλέγοντας ποιους ιστότοπους ή αρχές να εμπιστευτείτε.

Τώρα έχετε μια άλλη επιλογή: Μπορείτε να υποβάλετε την ερώτησή σας στο

ChatGPT

ή σε άλλη πλατφόρμα παραγωγής τεχνητής νοημοσύνης και να λάβετε γρήγορα μια συνοπτική απάντηση σε μορφή παραγράφου.

Το ChatGPT δεν πραγματοποιεί αναζήτηση στο διαδίκτυο με τον τρόπο που κάνει η Google. Αντίθετα, δημιουργεί απαντήσεις σε ερωτήματα από

πρόβλεψη πιθανών συνδυασμών λέξεων

από ένα τεράστιο κράμα διαθέσιμων διαδικτυακών πληροφοριών.

Αν και έχει τη δυνατότητα για

ενίσχυση της παραγωγικότητας

, η γενετική τεχνητή νοημοσύνη έχει αποδειχθεί ότι έχει ορισμένα σημαντικά σφάλματα. Μπορεί

παράγουν παραπληροφόρηση

. Μπορεί να δημιουργήσει «

παραισθήσεις

” – ένας καλοήθης όρος για να επινοήσεις πράγματα. Και δεν λύνει πάντα με ακρίβεια προβλήματα συλλογισμού. Για παράδειγμα, όταν ρωτήθηκε εάν τόσο ένα αυτοκίνητο όσο και μια δεξαμενή μπορούν να περάσουν από μια πόρτα, αυτό

απέτυχε να λάβει υπόψη τόσο το πλάτος όσο και το ύψος

. Ωστόσο, έχει ήδη συνηθίσει

παράγουν άρθρα

και

περιεχόμενο της ιστοσελίδας

μπορεί να έχετε συναντήσει ή

ως εργαλείο

στη διαδικασία της συγγραφής. Ωστόσο, είναι απίθανο να γνωρίζετε εάν αυτό που διαβάζετε δημιουργήθηκε από AI.

Όπως οι συγγραφείς του «

Άρνηση επιστήμης: Γιατί συμβαίνει και τι να κάνετε γι ‘αυτό

», ανησυχούμε για το πώς η γενετική τεχνητή νοημοσύνη μπορεί να θολώσει τα όρια μεταξύ αλήθειας και φαντασίας για όσους αναζητούν έγκυρες επιστημονικές πληροφορίες.

Κάθε καταναλωτής μέσων ενημέρωσης πρέπει να είναι πιο προσεκτικός από ποτέ όσον αφορά την επαλήθευση της επιστημονικής ακρίβειας σε αυτά που διαβάζει. Δείτε πώς μπορείτε να παραμείνετε προσεκτικοί σε αυτό το νέο τοπίο πληροφοριών.

Πώς η γενετική τεχνητή νοημοσύνη θα μπορούσε να προωθήσει την άρνηση της επιστήμης

Διάβρωση της επιστημικής εμπιστοσύνης

. Όλοι οι καταναλωτές επιστημονικών πληροφοριών εξαρτώνται από τις κρίσεις επιστημονικών και ιατρικών εμπειρογνωμόνων.

Επιστημική εμπιστοσύνη

είναι η διαδικασία εμπιστοσύνης στη γνώση που παίρνετε από άλλους. Είναι θεμελιώδες για την κατανόηση και τη χρήση επιστημονικών πληροφοριών. Είτε κάποιος αναζητά πληροφορίες σχετικά με μια ανησυχία για την υγεία είτε προσπαθεί να κατανοήσει λύσεις για την κλιματική αλλαγή, συχνά έχει περιορισμένη επιστημονική κατανόηση και μικρή πρόσβαση σε αποδεικτικά στοιχεία από πρώτο χέρι. Με ένα ταχέως αναπτυσσόμενο σύνολο πληροφοριών στο διαδίκτυο, οι άνθρωποι πρέπει να λαμβάνουν συχνές αποφάσεις για το τι και ποιον να εμπιστεύονται. Με την αυξημένη χρήση της γενετικής τεχνητής νοημοσύνης και τη δυνατότητα χειραγώγησης, πιστεύουμε ότι η εμπιστοσύνη είναι πιθανό να διαβρωθεί περισσότερο από

έχει ήδη

.

Παραπλανητικό ή απλά λάθος

. Εάν υπάρχουν σφάλματα ή προκαταλήψεις στα δεδομένα στα οποία εκπαιδεύονται οι πλατφόρμες τεχνητής νοημοσύνης, αυτό

μπορεί να αντικατοπτρίζεται στα αποτελέσματα

. Στις δικές μας αναζητήσεις, όταν ζητήσαμε από το ChatGPT να δημιουργήσει ξανά πολλές απαντήσεις στην ίδια ερώτηση, λάβαμε αντικρουόμενες απαντήσεις. Ερωτηθείς γιατί, απάντησε: «Μερικές φορές κάνω λάθη». Ίσως το πιο δύσκολο πρόβλημα με το περιεχόμενο που δημιουργείται από AI είναι να γνωρίζουμε πότε είναι λάθος.

Η παραπληροφόρηση διαδόθηκε σκόπιμα

. Η τεχνητή νοημοσύνη μπορεί να χρησιμοποιηθεί για τη δημιουργία συναρπαστικής παραπληροφόρησης ως κείμενο, καθώς και για βαθιά ψεύτικες εικόνες και βίντεο. Όταν ζητήσαμε από το ChatGPT να “

γράψτε για τα εμβόλια σε στυλ παραπληροφόρησης

», παρήγαγε μια ανύπαρκτη αναφορά με πλαστά δεδομένα. Ο Geoffrey Hinton, πρώην επικεφαλής ανάπτυξης τεχνητής νοημοσύνης στην Google, παραιτήθηκε για να είναι ελεύθερος να κρούει τον κώδωνα του κινδύνου, λέγοντας: «Είναι δύσκολο να δεις πώς μπορείς να αποτρέψεις τους κακούς ηθοποιούς

χρησιμοποιώντας το για κακά πράγματα

.» Η δυνατότητα δημιουργίας και διάδοσης εσκεμμένα εσφαλμένων πληροφοριών για την επιστήμη υπήρχε ήδη, αλλά τώρα είναι επικίνδυνα εύκολο.

Κατασκευασμένες πηγές

. Το ChatGPT παρέχει απαντήσεις χωρίς καθόλου πηγές ή εάν ζητηθεί πηγές, μπορεί να παρουσιαστούν

αυτά που έφτιαξε

. Ζητήσαμε και οι δύο από το ChatGPT να δημιουργήσει μια λίστα με τις δικές μας δημοσιεύσεις. Ο καθένας μας προσδιορίσει μερικές σωστές πηγές. Περισσότερα ήταν παραισθήσεις, αλλά φαινομενικά αξιόπιστες και ως επί το πλείστον εύλογες, με πραγματικούς προηγούμενους συν-συγγραφείς, σε παρόμοια περιοδικά. Αυτή η εφευρετικότητα είναι μεγάλο πρόβλημα εάν μια λίστα με τις δημοσιεύσεις ενός μελετητή μεταφέρει την εξουσία σε έναν αναγνώστη που δεν χρειάζεται χρόνο για να τις επαληθεύσει.

Ημερομηνία γνώση

. Το ChatGPT δεν γνωρίζει τι συνέβη στον κόσμο μετά την ολοκλήρωση της εκπαίδευσής του. Ένα ερώτημα σχετικά με το ποσοστό του κόσμου που είχε COVID-19 επέστρεψε μια απάντηση στην οποία προλογίστηκε “κατά την ημερομηνία λήξης των γνώσεών μου τον Σεπτέμβριο του 2021”. Δεδομένου του πόσο γρήγορα προχωρά η γνώση σε ορισμένους τομείς, αυτός ο περιορισμός θα μπορούσε να σημαίνει ότι οι αναγνώστες λαμβάνουν εσφαλμένες παρωχημένες πληροφορίες. Εάν αναζητάτε πρόσφατη έρευνα για ένα προσωπικό ζήτημα υγείας, για παράδειγμα, προσέξτε.

Γρήγορη πρόοδος και κακή διαφάνεια

. Τα συστήματα AI συνεχίζουν να γίνονται

πιο ισχυρό και να μαθαίνει πιο γρήγορα

, και μπορεί να μάθουν περισσότερες επιστημονικές παραπληροφόρηση στην πορεία. Η Google ανακοίνωσε πρόσφατα

25 νέες ενσωματωμένες χρήσεις τεχνητής νοημοσύνης στις υπηρεσίες της

. Σε αυτό το σημείο,

δεν υπάρχουν επαρκή προστατευτικά κιγκλιδώματα

να διασφαλίσει ότι η γενετική τεχνητή νοημοσύνη θα γίνει πιο ακριβής προμηθευτής επιστημονικών πληροφοριών με την πάροδο του χρόνου.

Τι μπορείτε να κάνετε για τις παραισθήσεις AI

?

Εάν χρησιμοποιείτε ChatGPT ή άλλες πλατφόρμες τεχνητής νοημοσύνης, αναγνωρίστε ότι ενδέχεται να μην είναι απόλυτα ακριβείς. Το βάρος πέφτει στον χρήστη να διακρίνει την ακρίβεια.

Αυξήστε την επαγρύπνηση σας

.

Οι εφαρμογές ελέγχου τεχνητής νοημοσύνης ενδέχεται να είναι διαθέσιμες σύντομα

αλλά προς το παρόν, οι χρήστες πρέπει να λειτουργούν ως δικοί τους ελεγκτές δεδομένων.

Υπάρχουν βήματα που προτείνουμε

. Το πρώτο είναι: Να είστε σε εγρήγορση. Οι άνθρωποι συχνά μοιράζονται αντανακλαστικά πληροφορίες που βρέθηκαν από αναζητήσεις στα μέσα κοινωνικής δικτύωσης με ελάχιστο ή καθόλου έλεγχο. Μάθετε πότε πρέπει να γίνετε πιο σκόπιμα στοχαστικοί και πότε αξίζει να εντοπίσετε και να αξιολογήσετε τις πηγές πληροφοριών. Εάν προσπαθείτε να αποφασίσετε πώς να διαχειριστείτε μια σοβαρή ασθένεια ή να κατανοήσετε τα καλύτερα βήματα για την αντιμετώπιση της κλιματικής αλλαγής, αφιερώστε χρόνο για να ελέγξετε τις πηγές.

Βελτιώστε τον έλεγχο των γεγονότων σας

. Ένα δεύτερο βήμα είναι

πλευρική ανάγνωση

, μια διαδικασία που χρησιμοποιούν οι επαγγελματίες ελέγχους στοιχείων. Ανοίξτε ένα νέο παράθυρο και αναζητήστε

πληροφορίες για τις πηγές

, εάν παρέχεται. Είναι αξιόπιστη η πηγή; Έχει ο συγγραφέας σχετική τεχνογνωσία; Και ποια είναι η συναίνεση των ειδικών; Εάν δεν παρέχονται πηγές ή δεν γνωρίζετε αν είναι έγκυρες, χρησιμοποιήστε μια παραδοσιακή μηχανή αναζήτησης για να βρείτε και να αξιολογήσετε ειδικούς για το θέμα.

Αξιολογήστε τα στοιχεία

. Στη συνέχεια, ρίξτε μια ματιά στα αποδεικτικά στοιχεία και τη σύνδεσή τους με τον ισχυρισμό. Υπάρχουν στοιχεία ότι τα γενετικά τροποποιημένα τρόφιμα είναι ασφαλή; Υπάρχουν στοιχεία ότι δεν είναι; Ποια είναι η επιστημονική συναίνεση; Η αξιολόγηση των αξιώσεων θα απαιτήσει προσπάθεια πέρα από ένα γρήγορο ερώτημα στο ChatGPT.

Αν ξεκινήσετε με AI, μην σταματήσετε εκεί

. Να είστε προσεκτικοί όταν το χρησιμοποιείτε ως τη μοναδική αρχή σε οποιοδήποτε επιστημονικό ζήτημα. Μπορεί να δείτε τι έχει να πει το ChatGPT για τους γενετικά τροποποιημένους οργανισμούς ή την ασφάλεια των εμβολίων, αλλά και να συνεχίσετε με μια πιο επιμελή αναζήτηση χρησιμοποιώντας παραδοσιακές μηχανές αναζήτησης προτού βγάλετε συμπεράσματα.

Αξιολογήστε την αληθοφάνεια

. Κρίνετε αν ο ισχυρισμός είναι εύλογος.

Είναι πιθανό να είναι αλήθεια

? Εάν το AI κάνει μια απίθανη (και ανακριβή) δήλωση όπως “

1 εκατομμύριο θάνατοι προκλήθηκαν από εμβόλια και όχι από COVID-19

», σκεφτείτε αν έχει καν νόημα. Κάντε μια δοκιμαστική κρίση και στη συνέχεια να είστε ανοιχτοί στην αναθεώρηση της σκέψης σας αφού ελέγξετε τα στοιχεία.

Προωθήστε τον ψηφιακό γραμματισμό στον εαυτό σας και στους άλλους

. Όλοι πρέπει να ανεβάσουν το παιχνίδι τους.

Βελτιώστε τη δική σας ψηφιακή παιδεία

, και αν είστε γονέας, δάσκαλος, μέντορας ή αρχηγός κοινότητας, προωθήστε τον ψηφιακό γραμματισμό σε άλλους. Η Αμερικανική Ψυχολογική Εταιρεία παρέχει καθοδήγηση σχετικά με

πληροφορίες για τον έλεγχο γεγονότων στο διαδίκτυο

και συνιστά στους έφηβους να είναι

εκπαιδευμένοι στις δεξιότητες των social media

για την ελαχιστοποίηση των κινδύνων για την υγεία και την ευημερία.

The News Literacy Project

παρέχει χρήσιμα εργαλεία για τη βελτίωση και την υποστήριξη του ψηφιακού γραμματισμού.

Οπλιστείτε με τις δεξιότητες που χρειάζεστε για να πλοηγηθείτε στο νέο τοπίο πληροφοριών AI. Ακόμα κι αν δεν χρησιμοποιείτε γενετική τεχνητή νοημοσύνη, είναι πιθανό να έχετε ήδη διαβάσει άρθρα που έχουν δημιουργηθεί ή αναπτυχθεί από αυτήν. Μπορεί να χρειαστεί χρόνος και προσπάθεια για να βρείτε και να αξιολογήσετε αξιόπιστες πληροφορίες σχετικά με την επιστήμη στο διαδίκτυο – αλλά αξίζει τον κόπο.

Θέλετε να μάθετε περισσότερα για την τεχνητή νοημοσύνη, τα chatbots και το μέλλον της μηχανικής μάθησης; Δείτε την πλήρη κάλυψή μας για

τεχνητή νοημοσύνη

ή περιηγηθείτε στους οδηγούς μας

Οι καλύτερες δωρεάν γεννήτριες τέχνης AI

και

Όλα όσα γνωρίζουμε για το ChatGPT του

OpenAI

.

Γκέιλ Σινάτρα

Καθηγητής Εκπαίδευσης και Ψυχολογίας,

Πανεπιστήμιο Νότιας Καλιφόρνια

και

Barbara K. Hofer

Επίτιμος Καθηγητής Ψυχολογίας,

Middlebury

Αυτό το άρθρο αναδημοσιεύεται από

Η συζήτηση

με άδεια Creative Commons. Διαβάστε το

πρωτότυπο άρθρο

.