Το OpenAI αναπτύσσει το LLM που χρησιμοποιεί μια αλυσίδα σκέψης όπως οι άνθρωποι

Related Posts

Το OpenAI κυκλοφόρησε

ένα νέο χαρτί

περιγράφοντας ορισμένες προόδους που έχει κάνει για την εξάλειψη του κοινού προβλήματος των παραισθήσεων όπου η τεχνητή νοημοσύνη απλώς συνθέτει πράγματα. Η εργασία περιγράφει δύο μοντέλα που ονομάζονται επίβλεψη έκβασης και επίβλεψη διαδικασίας για την εξάλειψη των παραισθήσεων και τον τρόπο λειτουργίας τους.

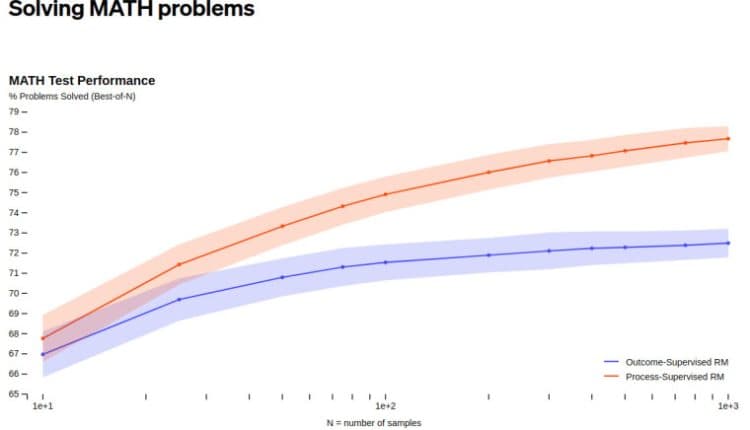

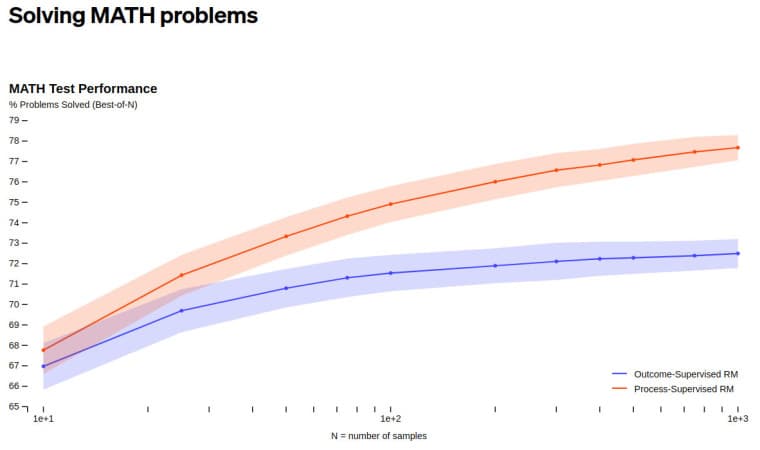

Με την επίβλεψη των αποτελεσμάτων, το OpenAI εκπαιδεύει μοντέλα επιβράβευσης για να παρέχουν σχόλια σχετικά με το τελικό αποτέλεσμα που δίνει η τεχνητή νοημοσύνη. Με την επίβλεψη της διαδικασίας, το μοντέλο ανταμοιβής παρέχει ανατροφοδότηση σε κάθε βήμα της διαδρομής, δημιουργώντας μια ανθρώπινη αλυσίδα σκέψης.

Στην ερευνητική του εργασία, το OpenAI δοκίμασε και τα δύο μοντέλα σε ένα μαθηματικό σύνολο δεδομένων και διαπίστωσε ότι η μέθοδος εποπτείας της διαδικασίας οδήγησε σε «σημαντικά καλύτερη απόδοση». Είναι σημαντικό να σημειωθεί ότι η μέθοδος εποπτείας διαδικασίας έχει δοκιμαστεί μόνο στον τομέα των μαθηματικών μέχρι στιγμής και ότι θα χρειαστεί περισσότερη δουλειά για να δούμε πώς αποδίδει γενικότερα.

Εξηγώντας τα πιθανά αποτελέσματα της μεθόδου εποπτείας της διαδικασίας, το OpenAI είπε:

“Εάν αυτά τα αποτελέσματα γενικευθούν, μπορεί να διαπιστώσουμε ότι η εποπτεία της διαδικασίας μας δίνει το καλύτερο και από τους δύο κόσμους – μια μέθοδος που είναι και πιο αποτελεσματική και πιο ευθυγραμμισμένη από την εποπτεία αποτελέσματος.”

Είναι ακόμη πολύ νωρίς για να πούμε πόσο αυτή η βήμα προς βήμα επαλήθευση θα βοηθήσει στην αντιμετώπιση των ψευδαισθήσεων γενικότερα, αλλά ελπίζουμε ότι θα το κάνει επειδή οι ψευδαισθήσεις είναι πιθανώς το νούμερο ένα πρόβλημα με τα LLM αυτή τη στιγμή. Μόλις αυτή την εβδομάδα, ένας δικηγόρος που είχε χρησιμοποιήσει το ChatGPT για την εργασία του και υπέβαλε ψευδείς πληροφορίες που περιγράφουν ψεύτικες υποθέσεις που είχε ονειρευτεί η τεχνητή νοημοσύνη.

Το OpenAI δεν έχει δώσει χρονοδιάγραμμα για το χρόνο που θα χρειαστεί για την εφαρμογή της εποπτείας διεργασιών στο ChatGPT που είναι διαθέσιμο στο κοινό. Είναι ακόμα σε ερευνητικό στάδιο και πρέπει να ελεγχθεί σε γενικές πληροφορίες.

Αν και τα αρχικά αποτελέσματα είναι καλά, το OpenAI αναφέρει ότι οι ασφαλέστερες μέθοδοι μπορούν να επιφέρουν μειωμένη απόδοση που ονομάζεται φόρος ευθυγράμμισης. Τα αποτελέσματα δείχνουν μέχρι στιγμής ότι η εποπτεία της διαδικασίας δεν επιβαρύνει αυτόν τον φόρο κατά την επεξεργασία μαθηματικών προβλημάτων, αλλά δεν γνωρίζουμε τι θα συμβεί σε πιο γενικές πληροφορίες.