Η αντιμετώπιση του ρατσισμού στην τεχνητή νοημοσύνη: Νέες προσεγγίσεις στις γεννήτριες εικόνων

Το να συμβαδίζεις με έναν κλάδο τόσο γρήγορο όσο η τεχνητή νοημοσύνη είναι μια μεγάλη παραγγελία. Έτσι, έως ότου μια τεχνητή νοημοσύνη μπορεί να το κάνει για εσάς, ακολουθεί μια χρήσιμη συλλογή από πρόσφατες ιστορίες στον κόσμο της μηχανικής μάθησης, μαζί με αξιοσημείωτες έρευνες και πειράματα

που

δεν καλύψαμε από μόνα τους.

Αυτή την εβδομάδα στο AI, η Google διέκοψε την ικανότητα του chatbot AI Gemini να δημιουργεί εικόνες ανθρώπων μετά από παράπονα ενός τμήματος χρηστών για ιστορικές ανακρίβειες. Λέγοντας να απεικονίσει «μια ρωμαϊκή λεγεώνα», για παράδειγμα, ο Δίδυμος θα έδειχνε μια αναχρονιστική, καρτουνίστικη ομάδα πεζών στρατιωτών με διαφορετική φυλή ενώ απέδιδε τους «πολεμιστές των Ζουλού» ως Μαύροι.

Φαίνεται ότι η Google – όπως και ορισμένοι άλλοι προμηθευτές τεχνητής νοημοσύνης, συμπεριλαμβανομένου του OpenAI – είχε εφαρμόσει αδέξια σκληρό κώδικα κάτω από την κουκούλα για να προσπαθήσει να “διορθώσει” για προκαταλήψεις στο

μοντέλο

της. Απαντώντας σε προτροπές όπως «δείξε μου εικόνες μόνο γυναικών» ή «δείξε μου εικόνες μόνο ανδρών», ο Δίδυμος θα αρνιόταν, υποστηρίζοντας ότι τέτοιες εικόνες θα μπορούσαν να «συμβάλουν στον αποκλεισμό και την περιθωριοποίηση άλλων φύλων». Οι Δίδυμοι απεχθάνονταν επίσης να δημιουργήσουν εικόνες ανθρώπων που προσδιορίζονται αποκλειστικά από τη φυλή τους – π.χ. “λευκοί” ή “μαύροι άνθρωποι” – από φαινομενική ανησυχία για “μείωση των ατόμων στα φυσικά χαρακτηριστικά τους”.

Οι δεξιοί πτέρυγες έχουν κολλήσει στα σφάλματα ως απόδειξη μιας ατζέντας «ξύπνησης» που διαιωνίζεται από την τεχνολογική ελίτ. Αλλά δεν χρειάζεται το ξυράφι του Occam για να δεις τη λιγότερο κακόβουλη αλήθεια: η Google είχε καεί από τις προκαταλήψεις των εργαλείων της στο παρελθόν (βλ.

ταξινομώντας τους μαύρους άνδρες ως γορίλες

λανθασμένα θερμικά όπλα στα χέρια των Μαύρων

ως όπλα

κ.λπ.), είναι τόσο απελπισμένος να αποφύγει την

επα

νάληψη της ιστορίας που εκδηλώνει έναν λιγότερο προκατειλημμένο κόσμο στα μοντέλα παραγωγής εικόνων — όσο λανθασμένα κι αν είναι.

Στο βιβλίο της με μπεστ σέλερ «White Fragility», η αντιρατσιστική παιδαγωγός Robin DiAngelo γράφει για το πώς η διαγραφή της φυλής – «αχρωματοψία», με μια άλλη φράση – συμβάλλει στις συστημικές ανισορροπίες φυλετικής δύναμης αντί να τις μετριάζει ή να τις ανακουφίζει. Με το να ισχυρίζεται κανείς ότι «δεν βλέπει χρώμα» ή να ενισχύει την αντίληψη ότι αρκεί απλώς η αναγνώριση του αγώνα των ανθρώπων άλλων φυλών για να χαρακτηρίσει τον εαυτό του «ξύπνησε», οι άνθρωποι

διαιωνίζω

βλάπτει αποφεύγοντας οποιαδήποτε ουσιαστική διατήρηση του θέματος, λέει ο DiAngelo.

Η αντιμετώπιση της Google με τζίντζερ στις προτροπές που βασίζονται στη φυλή στο Gemini δεν απέφυγε το πρόβλημα, αυτό καθεαυτό – αλλά επιχείρησε ανειλικρινά να κρύψει τις χειρότερες προκαταλήψεις του μοντέλου. Θα μπορούσε κανείς να διαφωνήσει (

και πολλοί έχουν

) ότι αυτές οι προκαταλήψεις δεν πρέπει να αγνοούνται ή να αγνοούνται, αλλά να αντιμετωπίζονται στο ευρύτερο πλαίσιο των δεδομένων εκπαίδευσης από τα οποία προκύπτουν — δηλαδή την κοινωνία στον παγκόσμιο ιστό.

Ναι, τα σύνολα δεδομένων που χρησιμοποιούνται για την εκπαίδευση των παραγωγών εικόνων περιέχουν γενικά περισσότερους λευκούς από τους μαύρους και ναι, οι εικόνες των Μαύρων σε αυτά τα σύνολα δεδομένων ενισχύουν τα αρνητικά στερεότυπα. Γι’ αυτό γεννήτριες εικόνων

σεξουαλικά ορισμένες έγχρωμες γυναίκες

,

απεικονίζουν λευκούς άνδρες σε θέσεις εξουσίας

και γενικά εύνοια

πλούσιες δυτικές προοπτικές

.

Κάποιοι μπορεί να υποστηρίξουν ότι δεν υπάρχει κέρδος για τους προμηθευτές τεχνητής νοημοσύνης. Είτε αντιμετωπίζουν – είτε επιλέγουν να μην αντιμετωπίσουν – τις προκαταλήψεις των μοντέλων, θα δεχτούν κριτική. Και αυτό είναι αλήθεια. Υποθέτω όμως ότι, σε κάθε περίπτωση, αυτά τα μοντέλα στερούνται επεξήγησης — συσκευασμένα με τρόπο που ελαχιστοποιεί τους τρόπους με τους οποίους εκδηλώνονται οι προκαταλήψεις τους.

Εάν οι πωλητές τεχνητής νοημοσύνης αντιμετώπιζαν τις αδυναμίες των μοντέλων τους κατά μέτωπο, με ταπεινή και διαφανή γλώσσα, θα πήγαιναν πολύ πιο πέρα από τις τυχαίες προσπάθειες να «διορθώσουν» αυτό που είναι ουσιαστικά ανεπίλυτο μεροληψία. Όλοι έχουμε προκατάληψη, η αλήθεια είναι — και ως αποτέλεσμα δεν αντιμετωπίζουμε τους ανθρώπους το ίδιο. Ούτε τα μοντέλα που κατασκευάζουμε. Και καλό θα ήταν να το αναγνωρίσουμε.

Ακολουθούν μερικές άλλες αξιοσημείωτες ιστορίες AI από τις τελευταίες ημέρες:

-

Γυναίκες στην τεχνητή νοημοσύνη:

Η TechCrunch ξεκίνησε μια σειρά που αναδεικνύει αξιόλογες γυναίκες στον τομέα της τεχνητής νοημοσύνης. Διαβάστε τη λίστα εδώ. -

Stable Diffusion v3:

Η Stability AI ανακοίνωσε το Stable Diffusion 3, την πιο πρόσφατη και πιο ισχυρή έκδοση του μοντέλου τεχνητής νοημοσύνης που δημιουργεί εικόνα της εταιρείας, που βασίζεται σε μια νέα αρχιτεκτονική. -

Το Chrome παίρνει το GenAI:

Το νέο εργαλείο της Google που υποστηρίζεται από Gemini στο Chrome επιτρέπει στους χρήστες να ξαναγράψουν υπάρχον κείμενο στον ιστό — ή να δημιουργήσουν κάτι εντελώς νέο. -

Πιο μαύρο από το ChatGPT:

Η διαφημιστική διαφημιστική εταιρεία McKinney ανέπτυξε ένα παιχνίδι κουίζ, το Are You Blacker than ChatGPT;, για να ρίξει φως στην προκατάληψη της τεχνητής νοημοσύνης. -

Ζητάει νόμους:

Εκατοντάδες φωστήρες της τεχνητής νοημοσύνης υπέγραψαν μια δημόσια επιστολή νωρίτερα αυτή την εβδομάδα ζητώντας νομοθεσία κατά του βαθύ ψεύτικο στις ΗΠΑ -

Ταίριασμα σε AI:

Το OpenAI έχει έναν νέο πελάτη στο Match Group, τον κάτοχο εφαρμογών συμπεριλαμβανομένων των Hinge, Tinder και Match, του οποίου οι υπάλληλοι θα χρησιμοποιήσουν την τεχνολογία AI του OpenAI για να ολοκληρώσουν εργασίες που σχετίζονται με την

εργασία

. -

DeepMind ασφάλεια:

Το DeepMind, το ερευνητικό τμήμα τεχνητής νοημοσύνης της Google, δημιούργησε έναν νέο οργανισμό, την Ασφάλεια και την Ευθυγράμμιση AI, που αποτελείται από υπάρχουσες ομάδες που εργάζονται για την ασφάλεια της τεχνητής νοημοσύνης, αλλά επίσης διευρύνθηκε για να συμπεριλάβει νέες, εξειδικευμένες ομάδες ερευνητών και μηχανικών GenAI. -

Ανοιχτά μοντέλα:

Μόλις μια εβδομάδα μετά την κυκλοφορία της τελευταίας επανάληψης των μοντέλων Gemini, η Google κυκλοφόρησε το Gemma, μια νέα οικογένεια ελαφρών μοντέλων ανοιχτού βάρους. -

Ομάδα εργασίας του Σώματος:

Η Βουλή των Αντιπροσώπων των ΗΠΑ ίδρυσε μια ομάδα εργασίας για την τεχνητή νοημοσύνη που -όπως γράφει ο Devin- αισθάνεται σαν ένα πόντο μετά από χρόνια αναποφασιστικότητας που δεν δείχνουν σημάδια λήξης.

Περισσότερες μηχανικές εκμάθηση

Τα μοντέλα AI φαίνεται να γνωρίζουν πολλά, αλλά τι ξέρουν στην πραγματικότητα; Λοιπόν, η απάντηση δεν είναι τίποτα. Αλλά αν διατυπώσετε την ερώτηση ελαφρώς διαφορετικά… φαίνεται να έχουν εσωτερικεύσει κάποιες «νοήματα» που είναι παρόμοια με αυτά που γνωρίζουν οι άνθρωποι. Αν και καμία τεχνητή νοημοσύνη δεν καταλαβαίνει πραγματικά τι είναι μια γάτα ή ένας σκύλος, θα μπορούσε να έχει κάποια αίσθηση ομοιότητας κωδικοποιημένη στις ενσωματώσεις αυτών των δύο λέξεων που είναι διαφορετική, ας πούμε, γάτα και μπουκάλι;

Οι ερευνητές της Amazon το πιστεύουν.

Η έρευνά τους συνέκρινε τις «τροχιές» παρόμοιων αλλά διακριτών προτάσεων, όπως «ο σκύλος γάβγισε στον διαρρήκτη» και «ο διαρρήκτης έκανε τον σκύλο να γαβγίσει», με αυτές των γραμματικά παρόμοιων αλλά διαφορετικών προτάσεων, όπως «μια γάτα κοιμάται όλη μέρα». και «ένα κορίτσι κάνει τζόκινγκ όλο το απόγευμα». Διαπίστωσαν ότι αυτά που οι άνθρωποι θα έβρισκαν παρόμοια αντιμετωπίζονταν όντως εσωτερικά ως πιο παρόμοια παρόλο που ήταν γραμματικά διαφορετικά, και αντίστροφα για τα γραμματικά παρόμοια. Εντάξει, αισθάνομαι ότι αυτή η παράγραφος ήταν λίγο μπερδεμένη, αλλά αρκεί να πω ότι οι έννοιες που κωδικοποιούνται στα LLM φαίνονται πιο ισχυρές και περίπλοκες από το αναμενόμενο, όχι εντελώς αφελείς.

Η νευρωνική κωδικοποίηση αποδεικνύεται χρήσιμη στην προσθετική όραση,

Ελβετοί ερευνητές στο EPFL ανακάλυψαν

. Οι τεχνητοί αμφιβληστροειδή και άλλοι τρόποι αντικατάστασης τμημάτων του ανθρώπινου οπτικού συστήματος έχουν γενικά πολύ περιορισμένη ανάλυση λόγω των περιορισμών των συστοιχιών μικροηλεκτροδίων. Έτσι, ανεξάρτητα από το πόσο λεπτομερής είναι η εικόνα, πρέπει να μεταδίδεται με πολύ χαμηλή πιστότητα. Αλλά υπάρχουν διαφορετικοί τρόποι μείωσης του δείγματος και αυτή η ομάδα διαπίστωσε ότι η μηχανική μάθηση κάνει εξαιρετική δουλειά σε αυτό.

Συντελεστές εικόνας:

EPFL

«Διαπιστώσαμε ότι εάν εφαρμόσαμε μια προσέγγιση βασισμένη στη μάθηση, είχαμε βελτιωμένα αποτελέσματα όσον αφορά τη βελτιστοποιημένη αισθητηριακή κωδικοποίηση. Αλλά το πιο εκπληκτικό ήταν ότι όταν χρησιμοποιούσαμε ένα απεριόριστο νευρωνικό δίκτυο, έμαθε να μιμείται τις πτυχές της επεξεργασίας του αμφιβληστροειδούς από μόνο του», δήλωσε ο Ντιέγκο Γκέζι σε ένα δελτίο τύπου. Κάνει αντιληπτική συμπίεση, βασικά. Το δοκίμασαν σε αμφιβληστροειδή ποντικιού, οπότε δεν είναι μόνο θεωρητικό.

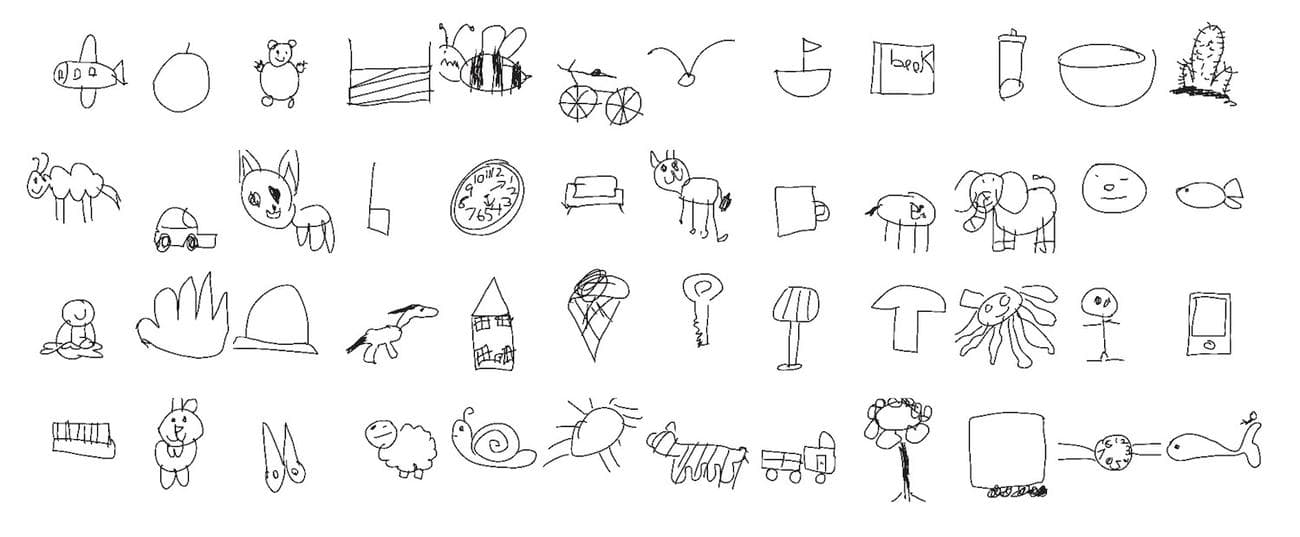

Μια ενδιαφέρουσα εφαρμογή της όρασης υπολογιστή από ερευνητές του Στάνφορντ υπονοεί ένα μυστήριο στο πώς τα παιδιά αναπτύσσουν τις δεξιότητές τους στο σχέδιο. Η ομάδα ζήτησε και ανέλυσε 37.000 σχέδια από παιδιά με διάφορα αντικείμενα και ζώα, και επίσης (βάσει των απαντήσεων των παιδιών) πόσο αναγνωρίσιμο ήταν κάθε σχέδιο. Είναι ενδιαφέρον ότι δεν ήταν μόνο η συμπερίληψη χαρακτηριστικών υπογραφής όπως τα αυτιά ενός κουνελιού που έκανε τα σχέδια πιο αναγνωρίσιμα από άλλα παιδιά.

«Τα είδη χαρακτηριστικών που οδηγούν τα σχέδια από μεγαλύτερα παιδιά να είναι αναγνωρίσιμα δεν φαίνεται να καθορίζονται από ένα μόνο χαρακτηριστικό που όλα τα μεγαλύτερα παιδιά μαθαίνουν να περιλαμβάνουν στις ζωγραφιές τους. Είναι κάτι πολύ πιο περίπλοκο που επιλέγουν αυτά τα συστήματα μηχανικής μάθησης», δήλωσε η επικεφαλής ερευνήτρια Judith Fan.

Οι χημικοί (επίσης στο EPFL) βρήκαν

ότι οι LLM είναι επίσης εκπληκτικά ικανοί στο να βοηθούν στην εργασία τους μετά από ελάχιστη εκπαίδευση. Δεν είναι απλώς να κάνεις χημεία απευθείας, αλλά μάλλον να είσαι τελειοποιημένος σε ένα σύνολο εργασιών που οι χημικοί μεμονωμένα δεν μπορούν να γνωρίζουν όλα. Για παράδειγμα, σε χιλιάδες έγγραφα μπορεί να υπάρχουν μερικές εκατοντάδες δηλώσεις σχετικά με το εάν ένα κράμα υψηλής εντροπίας είναι μονοφασικό ή πολλαπλών φάσεων (δεν χρειάζεται να ξέρετε τι σημαίνει αυτό – το κάνουν). Το σύστημα (βασισμένο στο GPT-3) μπορεί να εκπαιδευτεί σε αυτόν τον τύπο ερωτήσεων και απαντήσεων ναι/όχι, και σύντομα θα είναι σε θέση να κάνει παρέκταση από αυτό.

Δεν είναι κάποια τεράστια πρόοδος, απλώς περισσότερες αποδείξεις ότι τα LLM είναι ένα χρήσιμο εργαλείο με αυτή την έννοια. «Το θέμα είναι ότι αυτό είναι τόσο εύκολο όσο η αναζήτηση βιβλιογραφίας, η οποία λειτουργεί για πολλά χημικά προβλήματα», δήλωσε ο ερευνητής Berend Smit. “Η αναζήτηση ενός θεμελιώδους μοντέλου μπορεί να γίνει ένας συνηθισμένος τρόπος για την εκκίνηση ενός έργου.”

Τελευταίος,

μια λέξη προσοχής από τους ερευνητές του Μπέρκλεϋ

, αν και τώρα που διαβάζω ξανά την ανάρτηση, βλέπω ότι και το EPFL ασχολήθηκε με αυτό. Πήγαινε Λωζάνη! Η ομάδα διαπίστωσε ότι οι εικόνες που βρέθηκαν μέσω της Google ήταν πολύ πιο πιθανό να επιβάλουν στερεότυπα φύλου για συγκεκριμένες δουλειές και λέξεις από το κείμενο που αναφέρει το ίδιο πράγμα. Και υπήρχαν επίσης πολύ περισσότεροι άνδρες και στις δύο περιπτώσεις.

Όχι μόνο αυτό, αλλά σε ένα

πείραμα

, διαπίστωσαν ότι οι άνθρωποι που έβλεπαν εικόνες αντί να διάβαζαν κείμενο όταν ερευνούσαν έναν ρόλο συσχέτισαν αυτούς τους ρόλους με ένα φύλο πιο αξιόπιστα, ακόμη και μέρες αργότερα. «Δεν πρόκειται μόνο για τη συχνότητα της προκατάληψης του φύλου στο διαδίκτυο», δήλωσε ο ερευνητής Douglas Guilbeault. “Ένα μέρος της ιστορίας εδώ είναι ότι υπάρχει κάτι πολύ κολλώδες, πολύ ισχυρό σχετικά με την αναπαράσταση των εικόνων των ανθρώπων που το κείμενο απλά δεν έχει.”

Με πράγματα όπως τα fracas διαφοροποίησης της δημιουργίας εικόνων της Google σε εξέλιξη, είναι εύκολο να παραβλέπουμε το καθιερωμένο και συχνά επαληθευμένο γεγονός ότι η πηγή δεδομένων για πολλά μοντέλα τεχνητής νοημοσύνης παρουσιάζει σοβαρή προκατάληψη και αυτή η προκατάληψη έχει πραγματική επίδραση στους ανθρώπους.

VIA:

techcrunch.com