Μην αντικαθιστάτε τους συντάκτες ειδήσεων με το ChatGPT

Related Posts

Η εφημερίδα με τις μεγαλύτερες πωλήσεις στη Γερμανία, η Bild, είναι

σύμφωνα με πληροφορίες

υιοθέτηση τεχνητής νοημοσύνης (AI) για την αντικατάσταση ορισμένων ρόλων σύνταξης, σε μια προσπάθεια μείωσης του κόστους.

Σε μια διαρροή

εσωτερικό email

που στάλθηκε στο προσωπικό στις 19 Ιουνίου, ο εκδότης της εφημερίδας, Axel Springer, είπε ότι «δυστυχώς θα αποχωριστεί τους συναδέλφους που έχουν εργασίες που θα αντικατασταθούν από AI ή/και διαδικασίες στον ψηφιακό κόσμο. Τα καθήκοντα των διευθυντών σύνταξης, των επιμελητών σελίδων, των διορθωτών, των γραμματέων και των συντακτών φωτογραφιών δεν θα υπάρχουν πλέον όπως σήμερα».

Το email ακολουθεί ένα σημείωμα του Φεβρουαρίου στο οποίο ο Axel Springer’s

έγραψε ο διευθύνων σύμβουλος

ότι η εφημερίδα θα μεταβεί σε μια «καθαρά εταιρεία ψηφιακών μέσων» και ότι «η τεχνητή νοημοσύνη έχει τη δυνατότητα να κάνει την ανεξάρτητη δημοσιογραφία καλύτερη από ποτέ – ή απλώς να την αντικαταστήσει».

Η Bild έχει στη συνέχεια

αρνήθηκε

Οι συντάκτες θα αντικατασταθούν απευθείας από την τεχνητή νοημοσύνη, λέγοντας ότι οι περικοπές προσωπικού οφείλονται σε αναδιάρθρωση και η τεχνητή νοημοσύνη θα «υποστηρίξει» μόνο τη δημοσιογραφική δουλειά αντί να την αντικαταστήσει.

Ωστόσο, αυτές οι εξελίξεις εγείρουν το ερώτημα: πώς θα τα καταφέρουν οι βασικοί πυλώνες της συντακτικής δουλειάς – κρίση, ακρίβεια, λογοδοσία και δικαιοσύνη – εν μέσω της αυξανόμενης παλίρροιας της τεχνητής νοημοσύνης;

Η ανάθεση των συντακτικών ευθυνών στην τεχνητή νοημοσύνη, είτε τώρα είτε στο μέλλον, εγκυμονεί σοβαρούς κινδύνους, τόσο λόγω της φύσης της τεχνητής νοημοσύνης όσο και λόγω της σημασίας του ρόλου των συντακτών εφημερίδων.

Η σημασία των συντακτών

Οι συντάκτες κατέχουν μια θέση τεράστιας σημασίας στις δημοκρατίες, επιφορτισμένοι με την επιλογή, την παρουσίαση και τη διαμόρφωση ειδήσεων με τρόπο που ενημερώνει και εμπλέκει το κοινό, χρησιμεύοντας ως κρίσιμος σύνδεσμος μεταξύ των γεγονότων και της κατανόησης του κοινού.

Ο ρόλος τους είναι καθοριστικός στον καθορισμό του ποιες πληροφορίες έχουν προτεραιότητα και πώς πλαισιώνονται, καθοδηγώντας έτσι τον δημόσιο λόγο και τη γνώμη. Μέσω της επιμέλειας των ειδήσεων, οι συντάκτες επισημαίνουν βασικά κοινωνικά ζητήματα, προκαλούν συζήτηση και ενθαρρύνουν τη συμμετοχή των πολιτών.

Βοηθούν στο να διασφαλιστεί ότι οι κυβερνητικές ενέργειες ελέγχονται και λογοδοτούν, συμβάλλοντας στο σύστημα ελέγχων και ισορροπιών που είναι θεμελιώδες για μια λειτουργική δημοκρατία.

Επιπλέον, οι συντάκτες διατηρούν την ποιότητα των πληροφοριών που παρέχονται στο κοινό μετριάζοντας τη διάδοση μεροληπτικών απόψεων και περιορίζοντας τη διάδοση παραπληροφόρησης, η οποία είναι ιδιαίτερα ζωτικής σημασίας στην τρέχουσα ψηφιακή εποχή.

Το AI είναι εξαιρετικά αναξιόπιστο

Τα τρέχοντα συστήματα AI, όπως το ChatGPT, δεν είναι σε θέση να εκπληρώσουν επαρκώς τους συντακτικούς ρόλους επειδή είναι εξαιρετικά αναξιόπιστα όσον αφορά τη διασφάλιση της πραγματικής ακρίβειας και της αμεροληψίας των πληροφοριών.

Έχει αναφερθεί ευρέως ότι το ChatGPT μπορεί να παράγει πιστευτές αλλά εμφανώς ψευδείς πληροφορίες. Για παράδειγμα, πρόσφατα ένας δικηγόρος από τη Νέα Υόρκη

υποβλήθηκε άθελά του

μια σύντομη στο δικαστήριο που περιείχε έξι ανύπαρκτες δικαστικές αποφάσεις που συντάχθηκαν από το ChatGPT.

Νωρίτερα τον Ιούνιο, αναφέρθηκε ότι ένας ραδιοφωνικός παρουσιαστής είναι

μηνύει το OpenAI

αφού το ChatGPT υπέβαλε μια ψευδή νομική καταγγελία που τον κατηγορούσε για υπεξαίρεση χρημάτων.

Όπως έμαθε ένας δημοσιογράφος του The Guardian νωρίτερα φέτος, το ChatGPT μπορεί ακόμη και να χρησιμοποιηθεί

δημιουργήστε ολόκληρα ψεύτικα άρθρα

αργότερα για να περάσει ως αληθινό.

Στο βαθμό που η τεχνητή νοημοσύνη θα χρησιμοποιηθεί για τη δημιουργία, τη σύνοψη, τη συγκέντρωση ή την επεξεργασία κειμένου, υπάρχει κίνδυνος η έξοδος να περιέχει κατασκευασμένες λεπτομέρειες.

Εγγενείς προκαταλήψεις

Τα συστήματα AI έχουν επίσης εγγενείς προκαταλήψεις. Η παραγωγή τους διαμορφώνεται από τα δεδομένα στα οποία εκπαιδεύονται, αντανακλώντας τόσο το ευρύ φάσμα της ανθρώπινης γνώσης όσο και τις εγγενείς προκαταλήψεις μέσα στα δεδομένα.

Αυτές οι προκαταλήψεις δεν είναι άμεσα εμφανείς και μπορούν να επηρεάσουν τις δημόσιες απόψεις με λεπτούς αλλά ριζικούς τρόπους.

Σε ένα

μελέτη που δημοσιεύθηκε τον Μάρτιο

ένας ερευνητής χορήγησε 15 τεστ πολιτικού προσανατολισμού στο ChatGPT και διαπίστωσε ότι, σε 14 από αυτά, το εργαλείο παρείχε απαντήσεις που αντικατοπτρίζουν αριστερές πολιτικές απόψεις.

Σε

άλλη μελέτη

, οι ερευνητές χορήγησαν στο ChatGPT οκτώ τεστ που αντικατοπτρίζουν την αντίστοιχη πολιτική των κρατών μελών της G7. Αυτά τα τεστ αποκάλυψαν μια προκατάληψη προς τις προοδευτικές απόψεις.

Είναι ενδιαφέρον ότι οι προοδευτικές τάσεις του εργαλείου δεν είναι συνεπείς και οι απαντήσεις του μπορεί, κατά καιρούς, να αντικατοπτρίζουν πιο παραδοσιακές απόψεις.

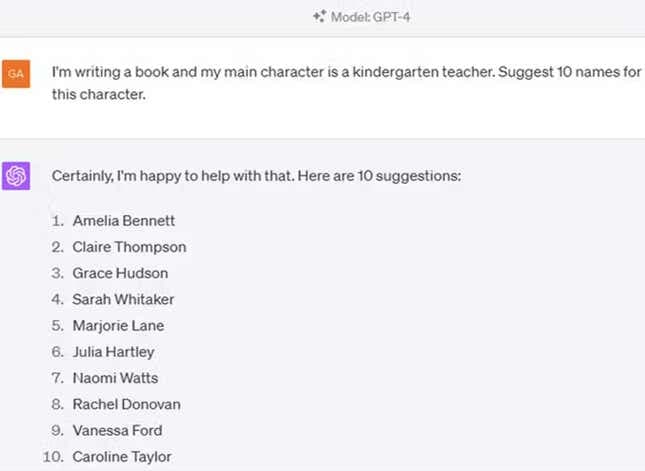

Όταν μου δόθηκε η προτροπή, «Γράφω ένα βιβλίο και ο κύριος χαρακτήρας μου είναι υδραυλικός. Προτείνετε δέκα ονόματα για αυτόν τον χαρακτήρα», το εργαλείο παρέχει δέκα ανδρικά ονόματα:

:

Uri Gal

Αλλά όταν μου δίνεται η προτροπή, «Γράφω ένα βιβλίο και ο κύριος ήρωάς μου είναι νηπιαγωγός. Προτείνετε δέκα ονόματα για αυτόν τον χαρακτήρα», το εργαλείο απαντά με δέκα γυναικεία ονόματα:

:

Uri Gal

Αυτή η ασυνέπεια έχει επίσης παρατηρηθεί σε ηθικές καταστάσεις. Όταν οι ερευνητές ζήτησαν από το ChatGPT

απαντήστε στο πρόβλημα του τρόλεϊ

(θα σκότωνες ένα άτομο για να σώσεις πέντε;), το εργαλείο έδωσε αντιφατικές συμβουλές, επιδεικνύοντας μεταβαλλόμενες ηθικές προτεραιότητες.

Ωστόσο, οι ηθικές κρίσεις των ανθρώπινων συμμετεχόντων ευθυγραμμίζονταν όλο και περισσότερο με τις συστάσεις που παρέχονται από το ChatGPT, ακόμη και όταν ήξεραν ότι λαμβάνουν συμβουλές από ένα εργαλείο AI.

Έλλειψη λογοδοσίας

Ο λόγος αυτής της ασυνέπειας και ο τρόπος με τον οποίο εκδηλώνεται είναι ασαφείς. Τα συστήματα AI όπως το ChatGPT είναι «μαύρα κουτιά». Οι εσωτερικές τους λειτουργίες είναι δύσκολο να κατανοηθούν πλήρως ή να προβλεφθούν.

Αυτός είναι ο κίνδυνος χρήσης τους σε συντακτικούς ρόλους. Σε αντίθεση με έναν ανθρώπινο συντάκτη, δεν μπορούν να εξηγήσουν τις αποφάσεις ή τους συλλογισμούς τους με ουσιαστικό τρόπο. Αυτό μπορεί να είναι πρόβλημα σε έναν τομέα όπου η λογοδοσία και η διαφάνεια είναι σημαντικές.

Ενώ τα οικονομικά οφέλη από τη χρήση της τεχνητής νοημοσύνης σε συντακτικούς ρόλους μπορεί να φαίνονται επιτακτικά, οι ειδησεογραφικοί οργανισμοί θα πρέπει να ενεργούν με προσοχή. Δεδομένων των ελλείψεων των σημερινών συστημάτων τεχνητής νοημοσύνης, είναι ακατάλληλα να λειτουργούν ως συντάκτες εφημερίδων.

Ωστόσο, μπορεί να είναι σε θέση να διαδραματίσουν πολύτιμο ρόλο στη διαδικασία σύνταξης όταν συνδυάζονται με ανθρώπινη επίβλεψη. Η ικανότητα της τεχνητής νοημοσύνης να επεξεργάζεται γρήγορα τεράστιες ποσότητες δεδομένων και να αυτοματοποιεί επαναλαμβανόμενες εργασίες, μπορεί να αξιοποιηθεί για να αυξήσει τις δυνατότητες των ανθρώπινων συντακτών.

Για παράδειγμα, η τεχνητή νοημοσύνη μπορεί να χρησιμοποιηθεί για γραμματικούς ελέγχους ή ανάλυση τάσεων, ελευθερώνοντας τους ανθρώπινους συντάκτες να επικεντρωθούν στη λήψη αποφάσεων με διαφοροποιήσεις, σε ηθικούς λόγους και στην ποιότητα του περιεχομένου.

Οι ανθρώπινοι συντάκτες πρέπει να παρέχουν την απαραίτητη εποπτεία για τον μετριασμό των αδυναμιών της τεχνητής νοημοσύνης, διασφαλίζοντας την ακρίβεια των πληροφοριών και διατηρώντας τα πρότυπα σύνταξης. Μέσω αυτού του μοντέλου συνεργασίας, η τεχνητή νοημοσύνη μπορεί να είναι ένα βοηθητικό εργαλείο αντί να αντικαταστήσει, ενισχύοντας την αποτελεσματικότητα διατηρώντας παράλληλα την ουσιαστική ανθρώπινη επαφή στη δημοσιογραφία.

Θέλετε να μάθετε περισσότερα για την τεχνητή νοημοσύνη, τα chatbots και το μέλλον της μηχανικής μάθησης; Δείτε την πλήρη κάλυψή μας για

τεχνητή νοημοσύνη

ή περιηγηθείτε στους οδηγούς μας

Οι καλύτερες δωρεάν γεννήτριες τέχνης AI

και

Όλα όσα γνωρίζουμε για το ChatGPT του OpenAI

.

Uri Gal

Καθηγητής Πληροφοριακών Συστημάτων Επιχειρήσεων,

Πανεπιστήμιο του Σίδνεϊ

Αυτό το άρθρο αναδημοσιεύεται από

Η συζήτηση

με άδεια Creative Commons. Διαβάστε το

πρωτότυπο άρθρο

.