Πώς πρέπει ένα AI να εξερευνήσει τη Σελήνη;

Related Posts

:

Πανεπιστήμιο της Αλμπέρτα

Η ταχεία πρόοδος στην τεχνητή νοημοσύνη (AI) έχει ωθήσει ορισμένες κορυφαίες φωνές στον τομέα

καλέστε για παύση της έρευνας

αυξάνουν την πιθανότητα

Ανθρώπινη εξαφάνιση με γνώμονα την τεχνητή νοημοσύνη

και ακόμα

ζητήσει κυβερνητική ρύθμιση

. Στο επίκεντρο της ανησυχίας τους είναι η ιδέα ότι το AI μπορεί να γίνει τόσο ισχυρό που χάνουμε τον έλεγχό του.

Μήπως όμως έχουμε χάσει ένα πιο θεμελιώδες πρόβλημα;

Σε τελική ανάλυση, τα συστήματα τεχνητής νοημοσύνης θα πρέπει να βοηθούν τους ανθρώπους να λαμβάνουν καλύτερες, πιο ακριβείς αποφάσεις. Ωστόσο, ακόμη και τα πιο εντυπωσιακά και ευέλικτα από τα σημερινά εργαλεία τεχνητής νοημοσύνης – όπως τα μεγάλα μοντέλα γλώσσας πίσω από τα όπως το ChatGPT – μπορεί να έχουν το αντίθετο αποτέλεσμα.

Γιατί; Έχουν δύο κρίσιμες αδυναμίες. Δεν βοηθούν τους υπεύθυνους λήψης αποφάσεων να κατανοήσουν την αιτιότητα ή την αβεβαιότητα. Και δημιουργούν κίνητρα για τη συλλογή τεράστιων ποσοτήτων δεδομένων και μπορεί να ενθαρρύνουν μια χαλαρή στάση απέναντι στο απόρρητο, νομικά και ηθικά ερωτήματα και κινδύνους.

Αιτία, αποτέλεσμα και εμπιστοσύνη

Το ChatGPT και άλλα «μοντέλα θεμελίωσης» χρησιμοποιούν μια προσέγγιση που ονομάζεται βαθιά μάθηση για να περιηγηθούν μέσα από τεράστια σύνολα δεδομένων και να εντοπίσουν συσχετίσεις μεταξύ παραγόντων που περιέχονται σε αυτά τα δεδομένα, όπως τα πρότυπα της γλώσσας ή οι σύνδεσμοι μεταξύ εικόνων και περιγραφών. Κατά συνέπεια, είναι εξαιρετικοί στην παρεμβολή – δηλαδή στην πρόβλεψη ή στην πλήρωση των κενών μεταξύ γνωστών τιμών.

Η παρεμβολή δεν είναι το ίδιο με τη δημιουργία. Δεν παράγει γνώση, ούτε τις απαραίτητες γνώσεις για τους υπεύθυνους λήψης αποφάσεων που λειτουργούν σε πολύπλοκα περιβάλλοντα.

Ωστόσο, αυτές οι προσεγγίσεις απαιτούν τεράστιο όγκο δεδομένων. Ως αποτέλεσμα, ενθαρρύνουν τους οργανισμούς να συγκεντρώνουν τεράστιες αποθήκες δεδομένων – ή να περιηγούνται σε υπάρχοντα σύνολα δεδομένων που συλλέγονται για άλλους σκοπούς. Η ενασχόληση με τα «μεγάλα δεδομένα» εγκυμονεί σημαντικούς κινδύνους σχετικά με την ασφάλεια, το απόρρητο, τη νομιμότητα και την ηθική.

Σε καταστάσεις χαμηλού πονταρίσματος, οι προβλέψεις που βασίζονται στο «τι υποδηλώνουν τα δεδομένα θα συμβεί» μπορεί να είναι απίστευτα χρήσιμες. Αλλά όταν το διακύβευμα είναι υψηλότερο, υπάρχουν δύο ακόμη ερωτήματα που πρέπει να απαντήσουμε.

Το πρώτο αφορά το πώς λειτουργεί ο κόσμος: «τι οδηγεί αυτό το αποτέλεσμα;» Το δεύτερο αφορά τη γνώση μας για τον κόσμο: «πόσο σίγουροι είμαστε για αυτό;»

Από μεγάλα δεδομένα έως χρήσιμες πληροφορίες

Ίσως παραδόξως, τα συστήματα AI που έχουν σχεδιαστεί για να συνάγουν αιτιώδεις σχέσεις δεν χρειάζονται «μεγάλα δεδομένα». Αντίθετα, χρειάζονται

ΧΡΗΣΙΜΕΣ ΠΛΗΡΟΦΟΡΙΕΣ

. Η χρησιμότητα των πληροφοριών εξαρτάται από το ερώτημα που έχουμε, τις αποφάσεις που αντιμετωπίζουμε και την αξία που αποδίδουμε στις συνέπειες αυτών των αποφάσεων.

Για να παραφράσουμε τον Αμερικανό στατιστικολόγο και συγγραφέα Nate Silver, ο

ποσότητα αλήθειας

είναι περίπου σταθερή ανεξάρτητα από τον όγκο των δεδομένων που συλλέγουμε.

Λοιπόν, ποια είναι η λύση; Η διαδικασία ξεκινά με την ανάπτυξη τεχνικών τεχνητής νοημοσύνης που μας λένε τι πραγματικά δεν γνωρίζουμε, αντί να παράγουν παραλλαγές της υπάρχουσας γνώσης.

Γιατί; Επειδή αυτό μας βοηθά να εντοπίσουμε και να αποκτήσουμε την ελάχιστη ποσότητα πολύτιμων πληροφοριών, με μια σειρά που θα μας επιτρέψει να ξεχωρίσουμε τις αιτίες και τα αποτελέσματα.

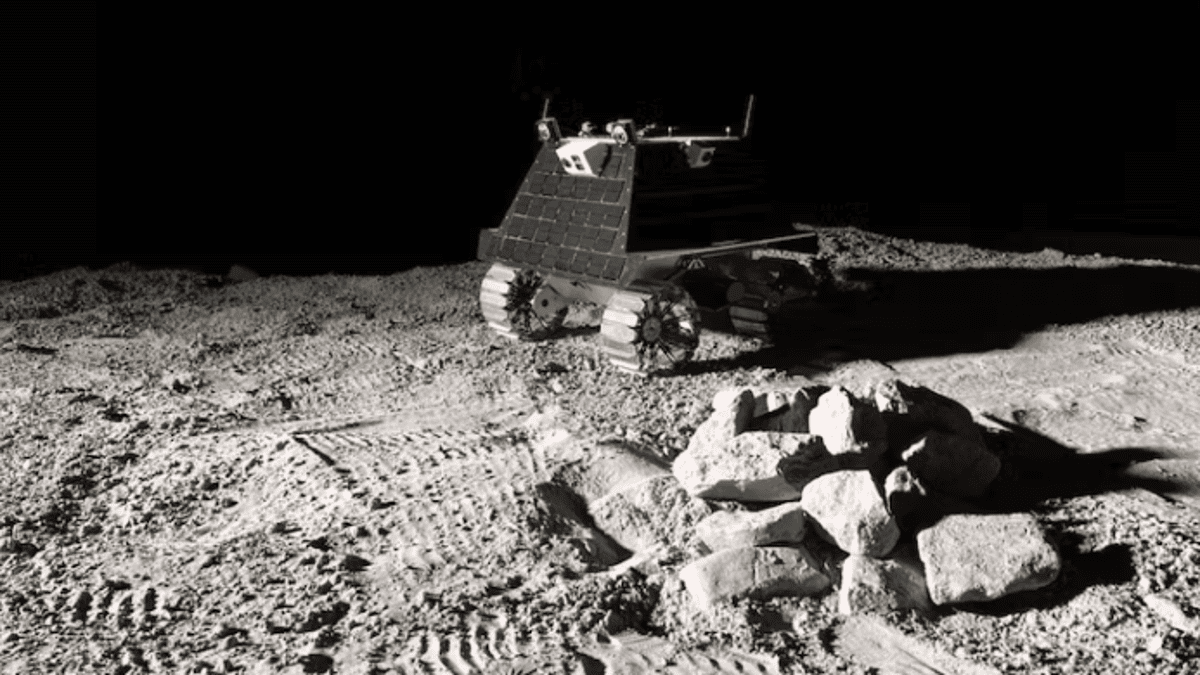

Ένα ρομπότ στη Σελήνη

Τέτοια συστήματα τεχνητής νοημοσύνης οικοδόμησης γνώσης υπάρχουν ήδη.

Ως απλό παράδειγμα, σκεφτείτε ένα ρομπότ που στάλθηκε στη Σελήνη για να απαντήσει στην ερώτηση, “Πώς μοιάζει η επιφάνεια της Σελήνης;”

Οι σχεδιαστές του ρομπότ μπορεί να του δώσουν μια προηγούμενη «πίστη» για το τι θα βρει, μαζί με μια ένδειξη για το πόση «εμπιστοσύνη» πρέπει να έχει σε αυτήν την πεποίθηση. Ο βαθμός εμπιστοσύνης είναι εξίσου σημαντικός με την πεποίθηση, γιατί είναι ένα μέτρο του τι δεν γνωρίζει το ρομπότ.

Το ρομπότ προσγειώνεται και αντιμετωπίζει μια απόφαση: προς ποια κατεύθυνση πρέπει να πάει;

Δεδομένου ότι ο στόχος του ρομπότ είναι να μάθει όσο το δυνατόν γρηγορότερα για την επιφάνεια της Σελήνης, θα πρέπει να πάει προς την κατεύθυνση που μεγιστοποιεί τη μάθησή του. Αυτό μπορεί να μετρηθεί με το ποια νέα γνώση θα μειώσει την αβεβαιότητα του ρομπότ για το τοπίο – ή πόσο θα αυξήσει την εμπιστοσύνη του ρομπότ στις γνώσεις του.

Το ρομπότ πηγαίνει στη νέα του θέση, καταγράφει παρατηρήσεις χρησιμοποιώντας τους αισθητήρες του και ενημερώνει τις πεποιθήσεις του και τη σχετική εμπιστοσύνη. Με αυτόν τον τρόπο μαθαίνει για την επιφάνεια της Σελήνης με τον πιο αποτελεσματικό τρόπο.

Ρομποτικά συστήματα όπως αυτό -γνωστά ως “ενεργό SLAM” (Ενεργή ταυτόχρονη εντόπιση και χαρτογράφηση) – προτάθηκαν για πρώτη φορά

πριν από περισσότερα από 20 χρόνια

και εξακολουθούν να είναι ένα

ενεργό πεδίο έρευνας

. Αυτή η προσέγγιση της σταθερής συλλογής γνώσεων και της ενημέρωσης της κατανόησης βασίζεται σε μια στατιστική τεχνική που ονομάζεται

Μπεϋζιανή βελτιστοποίηση

.

Χαρτογράφηση άγνωστων τοπίων

Ένας υπεύθυνος λήψης αποφάσεων στην κυβέρνηση ή τη βιομηχανία αντιμετωπίζει περισσότερη πολυπλοκότητα από το ρομπότ στη Σελήνη, αλλά η σκέψη είναι η ίδια. Η δουλειά τους περιλαμβάνει την εξερεύνηση και τη χαρτογράφηση άγνωστων κοινωνικών ή οικονομικών τοπίων.

Ας υποθέσουμε ότι θέλουμε να αναπτύξουμε πολιτικές για να ενθαρρύνουμε όλα τα παιδιά να ευδοκιμήσουν στο σχολείο και να τελειώσουν το γυμνάσιο. Χρειαζόμαστε έναν εννοιολογικό χάρτη για το ποιες ενέργειες, σε ποια χρονική στιγμή και υπό ποιες συνθήκες, θα βοηθήσουν στην επίτευξη αυτών των στόχων.

Χρησιμοποιώντας τις αρχές του ρομπότ, διατυπώνουμε μια αρχική ερώτηση: «Ποια παρέμβαση(ες) θα βοηθήσει περισσότερο τα παιδιά;»

Στη συνέχεια, κατασκευάζουμε ένα προσχέδιο εννοιολογικού χάρτη χρησιμοποιώντας την υπάρχουσα γνώση. Χρειαζόμαστε επίσης ένα μέτρο της εμπιστοσύνης μας σε αυτή τη γνώση.

Στη συνέχεια αναπτύσσουμε ένα μοντέλο που ενσωματώνει διαφορετικές πηγές πληροφοριών. Αυτά δεν θα προέρχονται από ρομποτικούς αισθητήρες, αλλά από κοινότητες, βιωμένη εμπειρία και οποιεσδήποτε χρήσιμες πληροφορίες από καταγεγραμμένα δεδομένα.

Μετά από αυτό, με βάση την ανάλυση που ενημερώνει την κοινότητα και τις προτιμήσεις των ενδιαφερομένων, λαμβάνουμε μια απόφαση: «Ποιες ενέργειες πρέπει να υλοποιηθούν και υπό ποιες προϋποθέσεις;»

Τέλος, συζητάμε, μαθαίνουμε, ενημερώνουμε τις πεποιθήσεις και επαναλαμβάνουμε τη διαδικασία.

Μαθαίνοντας όσο προχωράμε

Αυτή είναι μια προσέγγιση “learning as we go”. Καθώς έρχονται νέες πληροφορίες, επιλέγονται νέες ενέργειες για τη μεγιστοποίηση ορισμένων προκαθορισμένων κριτηρίων.

Εκεί που η τεχνητή νοημοσύνη μπορεί να είναι χρήσιμη είναι να προσδιορίσουμε ποιες πληροφορίες είναι πιο πολύτιμες, μέσω αλγορίθμων που ποσοτικοποιούν αυτά που δεν γνωρίζουμε. Τα αυτοματοποιημένα συστήματα μπορούν επίσης να συλλέγουν και να αποθηκεύουν αυτές τις πληροφορίες με ρυθμό και σε μέρη όπου μπορεί να είναι δύσκολο για τον άνθρωπο.

Τα συστήματα τεχνητής νοημοσύνης όπως αυτό εφαρμόζουν αυτό που ονομάζεται α

Μπεϋζιανό πλαίσιο απόφασης-θεωρίας

. Τα μοντέλα τους είναι εξηγήσιμα και διαφανή, βασισμένα σε ρητές υποθέσεις. Είναι μαθηματικά αυστηροί και μπορούν να προσφέρουν εγγυήσεις.

Έχουν σχεδιαστεί για να εκτιμούν τις αιτιακές οδούς, για να βοηθήσουν στην καλύτερη παρέμβαση την καλύτερη στιγμή. Και ενσωματώνουν ανθρώπινες αξίες με το να συν-σχεδιάζονται και να εφαρμόζονται από τις κοινότητες που επηρεάζονται.

Πρέπει να μεταρρυθμίσουμε τους νόμους μας και να δημιουργήσουμε νέους κανόνες για να καθοδηγήσουμε τη χρήση δυνητικά επικίνδυνων συστημάτων τεχνητής νοημοσύνης. Αλλά είναι εξίσου σημαντικό να επιλέξετε εξαρχής το κατάλληλο εργαλείο για τη δουλειά.

Θέλετε να μάθετε περισσότερα για την τεχνητή νοημοσύνη, τα chatbots και το μέλλον της μηχανικής μάθησης; Δείτε την πλήρη κάλυψή μας για

τεχνητή νοημοσύνη

ή περιηγηθείτε στους οδηγούς μας

Οι καλύτερες δωρεάν γεννήτριες τέχνης AI

και

Όλα όσα γνωρίζουμε για το ChatGPT του OpenAI

.

Σάλι Κριπς

Διευθυντής Τεχνολογίας UTS Human Technology Institute, Καθηγητής Μαθηματικών και Στατιστικής,

University of Technology Sydney

;

Άλεξ Φίσερ

Επίτιμος Συνεργάτης,

Εθνικό Πανεπιστήμιο της Αυστραλίας

;

Έντουαρντ Σάντοου

Καθηγητής & Συνδιευθυντής, Ινστιτούτο Ανθρώπινης Τεχνολογίας,

University of Technology Sydney

;

Hadi Mohasel Afshar

Επικεφαλής ερευνητής,

University of Technology Sydney

και

Νίκολας Ντέιβις

Καθηγητής Βιομηχανίας Αναδυόμενης Τεχνολογίας και Συνδιευθυντής, Ινστιτούτο Ανθρώπινης Τεχνολογίας,

University of Technology Sydney

Αυτό το άρθρο αναδημοσιεύεται από

Η συζήτηση

με άδεια Creative Commons. Διαβάστε το

πρωτότυπο άρθρο

.