Τι πρέπει να γνωρίζετε για το υδατογράφημα της Google για εικόνες που δημιουργούνται από AI

Οι εικόνες που δημιουργούνται από την τεχνητή νοημοσύνη γίνονται όλο και πιο φωτορεαλιστικές, γεγονός που θα κάνει ακόμη πιο δύσκολο τον εντοπισμό των deepfakes και άλλων ειδών παραπληροφόρησης που βασίζεται σε εικόνες. Αλλά η ομάδα DeepMind της

Google

πιστεύει ότι μπορεί να έχει μια λύση: Ένα ειδικό εργαλείο υδατογράφησης που ονομάζεται

SynthID

.

Ανακοινώθηκε στο Google Cloud Next

αυτή την εβδομάδα, το SynthID είναι μια συνεργασία μεταξύ των ομάδων Google Cloud και Google DeepMind. Η έκδοση

beta

είναι ήδη διαθέσιμη για το Image through

Vertex AI

, η παραγωγική

πλατφόρμα

AI του Google Cloud. Προς το παρόν, λειτουργεί μόνο με το Imagen, τη συσκευή δημιουργίας κειμένου σε εικόνα τύπου DALL-E 2 της Google, αλλά η εταιρεία εξετάζει το ενδεχόμενο να φέρει παρόμοια τεχνολογία σε άλλα μοντέλα παρ

αγωγή

ς τεχνητής νοημοσύνης που είναι διαθέσιμα στον Ιστό.

Σύμφωνα με την

ανάρτηση ιστολογίου ανακοίνωσης

από την ομάδα DeepMind, το SynthID λειτουργεί ενσωματώνοντας ένα «ψηφιακό υδατογράφημα απευθείας στα pixel μιας εικόνας, καθιστώντας το ανεπαίσθητο στο ανθρώπινο μάτι, αλλά ανιχνεύσιμο για αναγνώριση». Είναι η προσπάθειά τους να βρουν «τη σωστή ισορροπία μεταξύ ανεπαίσθητου και ευρωστίας στους χειρισμούς εικόνας». Δύσκολη πρόκληση, αλλά σημαντική.

Όπως εξηγεί η ομάδα του DeepMind στην ανακοίνωση, «ενώ η γενετική τεχνητή νοημοσύνη μπορεί να ξεκλειδώσει τεράστιες δημιουργικές δυνατότητες, παρουσιάζει επίσης νέους κινδύνους, όπως το να δίνει τη δυνατότητα στους δημιουργούς να διαδίδουν ψευδείς πληροφορίες – σκόπιμα ή ακούσια». Η ύπαρξη κάποιου είδους συστήματος που θα βοηθά τους ανθρώπους και τις

πλατφόρμες

να αναγνωρίζουν περιεχόμενο που δημιουργείται από την τεχνητή νοημοσύνη θα είναι ζωτικής σημασίας για να σταματήσει ο πολλαπλασιασμός της παραπληροφόρησης.

Οι ερευνητές ισχυρίζονται ότι τα παραδοσιακά υδατογραφήματα—όπως τα λογότυπα που εφαρμόζονται στην κορυφή μιας φωτογραφίας στοκ—δεν είναι κατάλληλα για εικόνες που δημιουργούνται από τεχνητή νοημοσύνη, επειδή εάν είναι μικρές, μπορούν να επεξεργαστούν με πολύ λίγη προσπάθεια και εάν είναι μεγάλες και προφανές, «παρουσιάζουν αισθητικές προκλήσεις για δημιουργικούς ή εμπορικούς σκοπούς». (Με άλλα λόγια, φαίνονται πολύ άσχημα.)

Ομοίως, ενώ έχουν γίνει προσπάθειες να

αναπτύσσουν ανεπαίσθητα υδατογραφήματα

Στο παρελθόν, οι ερευνητές του DeepMind ισχυρίζονται ότι απλοί χειρισμοί όπως η αλλαγή μεγέθους της εικόνας μπορεί να είναι αρκετοί για να τους αφαιρέσουν.

Το SynthID λειτουργεί χρησιμοποιώντας δύο σχετικά μοντέλα τεχνητής νοημοσύνης που βασίζονται σε βαθιά μάθηση: Ένα για την υδατοσήμανση κάθε εικόνας και ένα για την αναγνώριση υδατογραφημάτων. Τα δύο μοντέλα εκπαιδεύτηκαν μαζί στο ίδιο «διαφορετικό σύνολο εικόνων» και το συνδυασμένο μοντέλο που προέκυψε έχει βελτιστοποιηθεί για να κάνει το υδατογράφημα όσο το δυνατόν πιο ανεπαίσθητο για τον άνθρωπο αλλά και εύκολα αναγνωρίσιμο από το AI.

[Related: The New York Times is the latest to go to battle against AI scrapers]

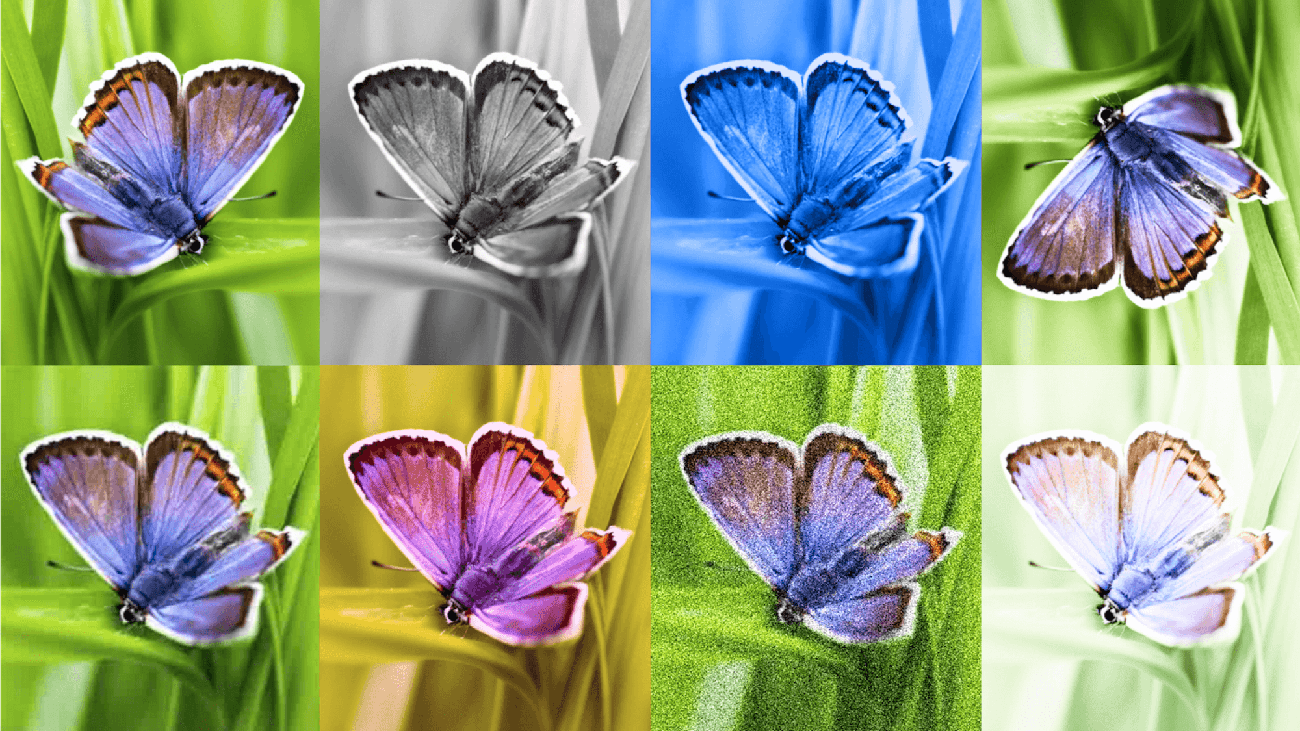

Είναι πολύ σημαντικό, το SynthID εκπαιδεύεται να ανιχνεύει τα ενσωματωμένα υδατογραφήματα ακόμα και μετά την επεξεργασία της αρχικής εικόνας. Πράγματα όπως η περικοπή, η αναστροφή ή η περιστροφή, η προσθήκη φίλτρου, η αλλαγή της φωτεινότητας, του χρώματος ή της αντίθεσης ή η χρήση αλγόριθμου συμπίεσης με απώλειες δεν θα αφαιρέσουν ένα υδατογράφημα από μια εικόνα — ή τουλάχιστον, όχι τόσο πολύ που το SynthID δεν μπορεί ακόμα εντοπίστε το. Ενώ πιθανώς υπάρχουν τρόποι να το αντιμετωπίσετε με επιθετική επεξεργασία, θα πρέπει να είναι αρκετά ανθεκτικό στις περισσότερες κοινές τροποποιήσεις.

Ως επιπλέον προστατευτικό κιγκλίδωμα, το SynthID έχει τρία επίπεδα εμπιστοσύνης. Εάν εντοπίσει το υδατογράφημα, μπορείτε να είστε αρκετά σίγουροι ότι το Imagen χρησιμοποιήθηκε για τη δημιουργία της εικόνας. Ομοίως, εάν δεν ανιχνεύσει το υδατογράφημα και η εικόνα δεν φαίνεται ότι έχει υποστεί επεξεργασία πέρα από κάθε πεποίθηση, είναι απίθανο η εικόνα να δημιουργήθηκε από την Imagen. Ωστόσο, εάν εντοπίσει πιθανώς το υδατογράφημα (ή, πιθανώς, περιοχές μιας εικόνας που μοιάζουν με υδατογράφημα SynthID), τότε θα στείλει μια προειδοποίηση για να το αντιμετωπίσετε με προσοχή.

Το SynthID δεν είναι μια άμεση λύση για deepfakes, αλλά επιτρέπει στους ηθικούς δημιουργούς να υδατογραφούν τις εικόνες τους, ώστε να μπορούν να αναγνωριστούν ως δημιουργημένες από AI. Εάν κάποιος χρησιμοποιεί εργαλεία μετατροπής κειμένου σε εικόνα για να δημιουργήσει σκόπιμη παραπληροφόρηση, είναι απίθανο να επιλέξει να επισημάνει τις εικόνες του ως δημιουργημένες από τεχνητή νοημοσύνη, αλλά τουλάχιστον μπορεί να αποτρέψει τη χρήση ορισμένων εικόνων τεχνητής νοημοσύνης εκτός πλαισίου.

Η ομάδα DeepMind στοχεύει το SynthID να είναι μέρος μιας «ευρείας σειράς προσεγγίσεων» για τον εντοπισμό τεχνητά παραγόμενου ψηφιακού περιεχομένου. Αν και θα πρέπει να είναι ακριβές και αποτελεσματικό, πράγματα όπως τα μεταδεδομένα, οι ψηφιακές υπογραφές και οι απλές οπτικές επιθεωρήσεις εξακολουθούν να αποτελούν μέρος της αναγνώρισης αυτών των τύπων εικόνων.

Στο εξής, η ομάδα συλλέγει σχόλια από τους χρήστες και αναζητά τρόπους βελτίωσης του SynthID—εξάλλου είναι ακόμα σε beta. Επίσης, διερευνούν την ενσωμάτωσή του με άλλα προϊόντα της Google και ακόμη και την κυκλοφορία του σε τρίτους «στο εγγύς μέλλον». Ο τελικός τους στόχος είναι αξιέπαινος: Τα Generative AI είναι εδώ, επομένως τα εργαλεία που τα χρησιμοποιούν πρέπει να ενδυναμώσουν «άτομα και οργανισμούς να εργάζονται υπεύθυνα με περιεχόμενο που δημιουργείται από AI». Διαφορετικά, θα κατακλυζόμαστε από πολλές πιθανές παραπληροφόρηση.